2018年6月21-22日,由布谷鸟科技、佐智汽车主办,艾拉比智能、ADI亚德诺半导体、索喜科技赞助支持的“2018第二届智能座舱与智能驾驶峰会”在深圳福田区绿景锦江酒店举办。路畅科技副总裁/CTO 胡锦敏博士在会上做了《融合,汽车智能驾驶舱的发展方向》的主题演讲。

路畅科技副总裁/CTO 胡锦敏博士

各位朋友,大家上午好!本次我主要分享智能驾驶舱发展趋势。

智能驾驶舱Cockpit的这个词,我Google了一下,发现关于飞机的信息比较多。当你Google “Smart Cockpit”,你会发现很多关于飞机的飞行手册,描写飞机驾驶舱的结构和操作的。我在一篇描述飞机智能驾驶舱的学术文章中,找到了智能驾驶舱的概念架构,这个驾驶舱系统分为环境监视、驾驶员状态监视、飞机状态监视、人机交互系统、决策执行系统五大模块。从结构来说,驾驶舱有屏幕、按钮、开关、操纵杆、方向舵,及其他。如果说智能驾驶舱就是中控大屏和仪表,是非常片面的。真正的驾驶舱还包括监视模块(监视飞机、监视飞行员、监视环境等)和决策执行系统。

与自动驾驶汽车分5个等级一样,飞机驾驶智能等级分为10个等级。

1级:飞机没有智能,全由人来负责决策和操作;

2级:计算机提供一个决策和执行全集由驾驶员自己选择;

3级:缩小决策和执行选项范围;

…………

10级:计算机自动决策执行,完全忽略人的介入。

智能化目的是减少人的介入。现在,汽车发展正在发生变革-即智能化、网联化、电动化、共享化。其中智能驾驶舱与智能化、网联化相关,同时也和出行相关,如仪表车机上显示和共享出行相关的监控信息。

我重点说驾驶舱与智能化相关部分。

自动驾驶汽车分5个等级,L1是FEET OFF,脚可以释放出来,就是具备自动紧急刹车功能;L2是HANDS OFF,方向盘由系统掌控;L3是EYES OFF,可以视线移开。所以说,在L3阶段前,智能驾驶舱的屏幕很重要,其可以显示车辆后面和环境周边信息;L4时屏幕重要性降低,车辆会提醒驾驶员何时介入接管;L5时,不需要人类接管了。

过去,就车辆看,主要关注是环境和车辆本身。现在,我们慢慢关注驾驶员、人机交互这些领域了。比如,监测驾驶员,包括疲劳监测(操作行为和习惯);比如人机交互(人机交互在达到L3级自动驾驶之前,是必须的而且非常有价值的)。

汽车智能驾驶舱概念架构有驾驶员监测、环境监测、汽车状态监测、人机交互系统和决策执行系统。其中,环境监测,包括毫米波雷达、激光雷达、摄像头等;汽车状态监测,包括钥匙系统,CAN等;驾驶员监测包含疲劳监视,以后可能会有健康监视等。人机交互部分,包括HUD、车机、仪表,还有基于输入的交互方式,手势、语音、人像识别、身份识别等。无人驾驶,主要是决策执行系统,获得信息,做出决策,如何让它更加智能。

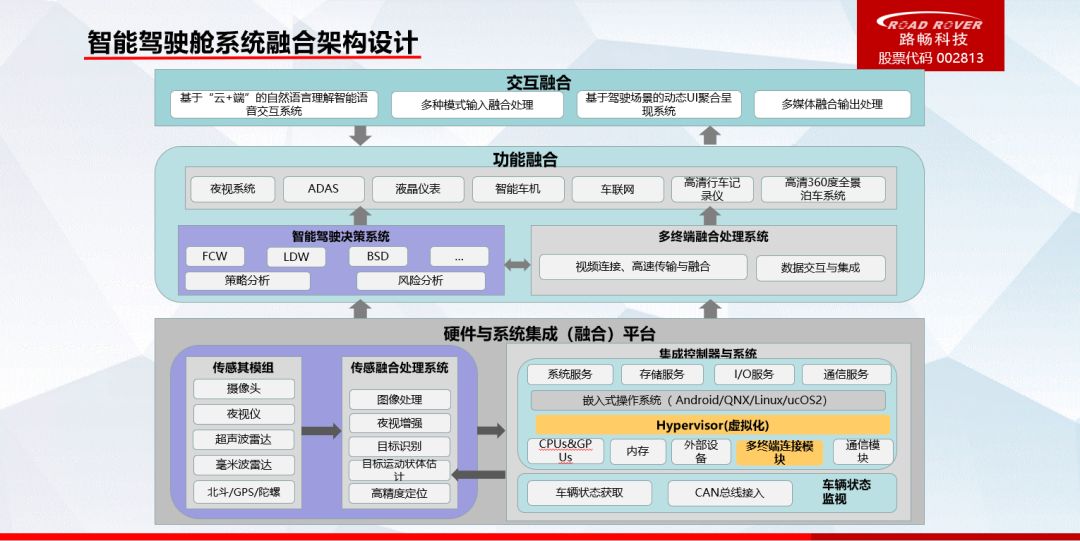

未来,智能驾驶舱发展的趋势就是走向融合,也就是这篇讲稿的主题。路畅的智能驾驶舱产品在逐步会融合ADAS展示、导航展示、摄像头盲区展示等功能。而这些功能的融合,需要重新设计UI布局,因为信息的展示是动态的,需要基于场景来触发。集成控制器会把相关功能融合在一起,这种融合不仅是SOC融合,是一个或多个功能的融合。

首先,来说下智能驾驶舱的融合架构设计。智能驾驶舱的融合架构设计有硬件与系统集成融合,有功能融合,有交互融合等。

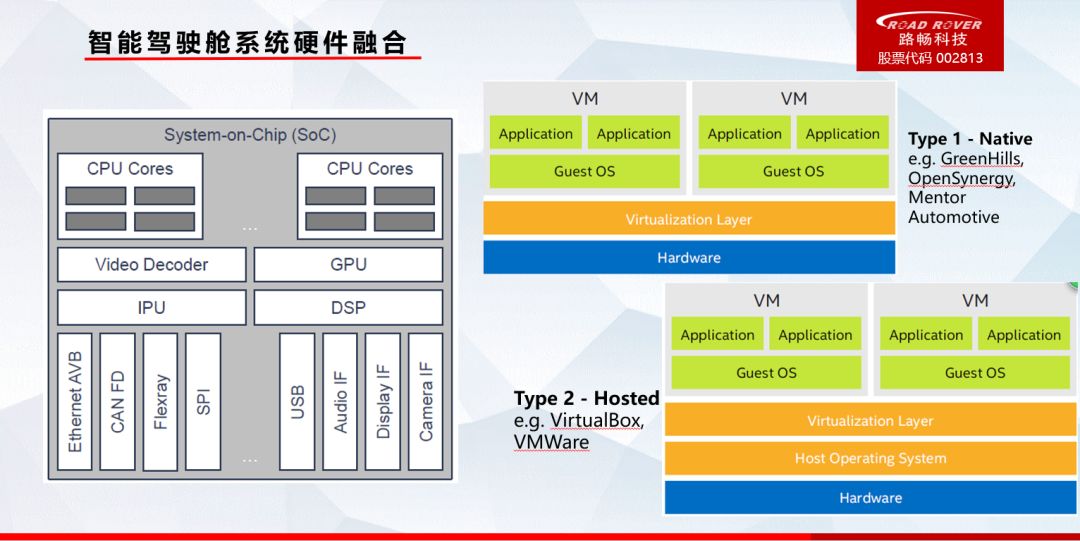

首先说下硬件融合。过去是把CPU、GPU融合,现在是CPU、GPU,甚至DSP、MCU进行融合,使得SOC功能更为强大。SOC的功能变得越来越强大,这是芯片发展趋势。

另外就是虚拟化,虚拟化有两种技术。

Type 1:嵌入式用Type 1方式比较多。Type 1依赖于硬件,因为嵌入式操作系统的底层会把这些和硬件的通讯重新包装。

Type2:云计算或者PC上应用Type 2比较多。举个例子,我们在PC上装VMWare再装Linux就是Type 2,是装Windows之后,在Windows上再安装虚拟机等。

我们关注虚拟机两个点,一是可靠性,二是信息或数据交互。比如,车机中有一个图片在仪表上显示,如果用hypervisor,就能够瞬间实现,同步速度快,通过内存共享,或虚拟总线、虚拟以太网等。如果用其分离的硬件,两个独立系统需要连接,比如用LVDS线,效果可能没有虚拟化这么好。

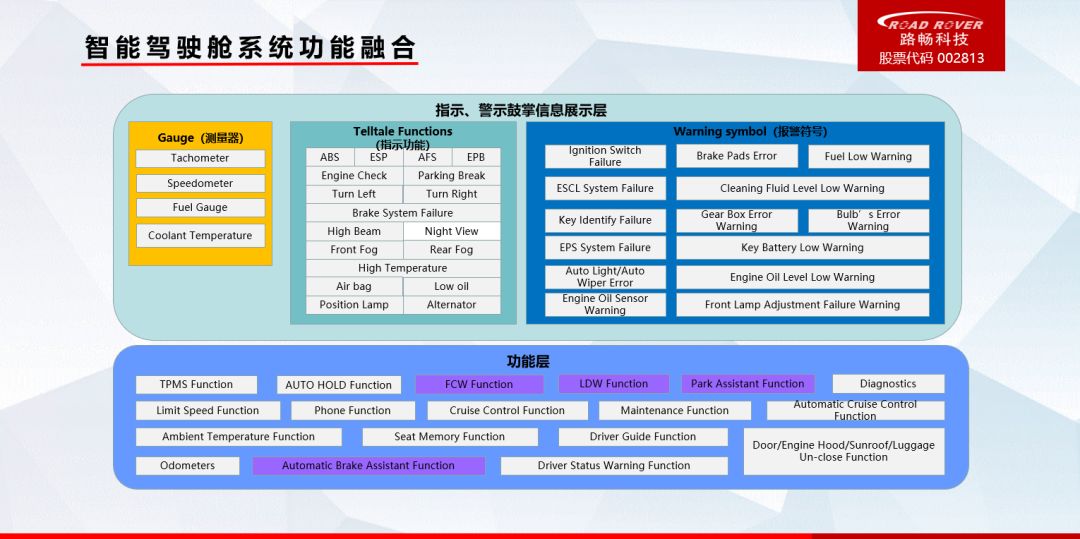

其次是功能融合。智能驾驶舱内可开发功能会越来越丰富,不仅传统功能会保留,未来还可能加入辅助驾驶相关,以及网络高清地图、高精度定位、增强定位等信息。

功能层融合以后,再把这些东西展示出来。比如特斯拉辅助驾驶,需要在仪表上展示辅助驾驶、碰撞等功能信息。开发的功能越多,配置越丰富,就越需要将它们整合起来。

第三是信息融合。信息融合,包括与充电信息融合、与车身状态信息融合、与环境融合、与互联网融合以及自身功能信息交互融合。信息融合是功能融合以及交互融合的关键,只有当所有信息进入到驾驶舱的集成控制器里面才能实现更多地功能。

对电动车来说,不仅需要展示电池管理、能量流等终端信息,还要包含车身状态等动态信息。

环境信息融合,就是将各种传感器(雷达、摄像头)监测到周边环境信息展示出来。比如自动泊车,首先通过12个超声波雷达能扫描出一个空间,发现有3个车位同时空着,这时决策系统把环境信息做分析处理,选择自动泊到哪个车位。

与互联网融合,包括T-BOX及云平台、娱乐多媒体信息融合、实时路况信息以及汽车分享信息等。

第四是交互融合。下面这个图中,IC是原来仪表,IVI是原来中控车机。原来中控车机显示导航,现在融合到仪表上进行显示,或者把更多信息融合起来。交互融合就是从不同的场景,不同的驾驶模式上叠加出不同的UI或者UX。

比如,当你开车的时候发现要碰撞到前面的车了,这时情况是自身车速快+前面车急刹车+自身车右转改道+右边有盲区。同时,汽车传感器的工作是毫米波雷达和摄像头监测车辆周围情况,中控仪表通过视频显示车后面状况,导航显示转向信息,这些信息如何显示,这就是交互融合层次需要处理的。

第五是结构外观融合。这个融合我们很少关注,仪表、车机,如何做到一体化,参考Faurcia的介绍,其未来发展趋势是Smart Surface——智能表面。从概念结构来看,智能驾驶舱会变得越来越智能,因为融入的信息和功能越来越多。

硬件融合、功能融合、信息融合、交互融合、结构外观融合,这就是我理解的汽车智能驾驶舱的发展方向。

全部0条评论

快来发表一下你的评论吧 !